北京时间9月13日凌晨,OpenAI 突然发布了 OpenAI o1系列模型,OpenAI CEO Sam Altman 高赞o1:“OpenAI o1是一个新范式的开始:可以进行通用复杂推理的AI。”

在我看来,OpenAI这次发布o1,营销策略与以往如出一辙——从在X平台上的“草莓”照片展示,到宣称Level 2的水平具备博士级的推理能力,再到每月200美元的费用以及比GPT-4o强100倍的夸张比喻,无一不是为了制造FOMO(害怕错过)的情绪。然而,在实际发布时却又设置了一系列限制,无论是仅提供o1-mini和o1-preview版本,并未放出完整的o1,还是每周仅限30次的调用次数。

为什么要这么做?

我觉得还是算力“惹的祸”。众所周知,OpenAI正在以1500亿美元的估值筹集65亿美元的资金。虽然GPT已经是单个收入最高的Gen-AI应用,但训练新模型的开销、高昂的人力成本,以及新模型运行所需的推理的算力,都成为了限制因素。

从预期的角度来看,在之前的各类OpenAI访谈中,我们已经遇见到这次主要的进步会是在推理能力上,并且使用的会是和之前不一样的方法。那比较容易猜到的就是从之前提示词的系统1思考方式转换到自主的Think Step by Step的系统2方式。

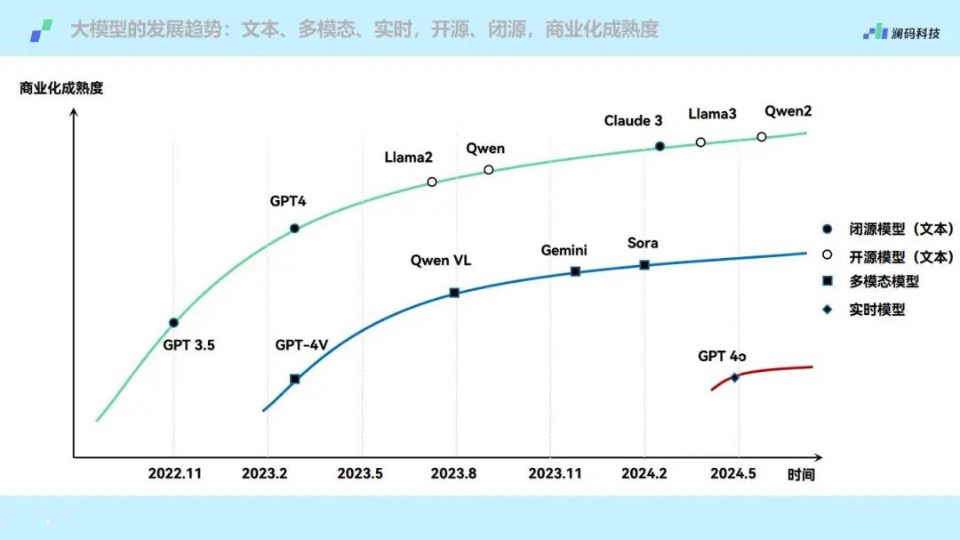

失望之处在于,推理能力仍然只在文本领域,完全不能处理多模态内容和实时处理。这也进一步验证了澜码的观点:即大模型的未来会分化为不同的品类,纯文本,多模态(离线),多模态(实时)将各自成为不同的赛道。

实际使用的结果网上已经有很多描述,这里我就不再重复了。应该说,OpenAI此次发布确实给大家看到了进步的可能性,虽然还是有低级的错误,例如9.11和9.9的大小比较。

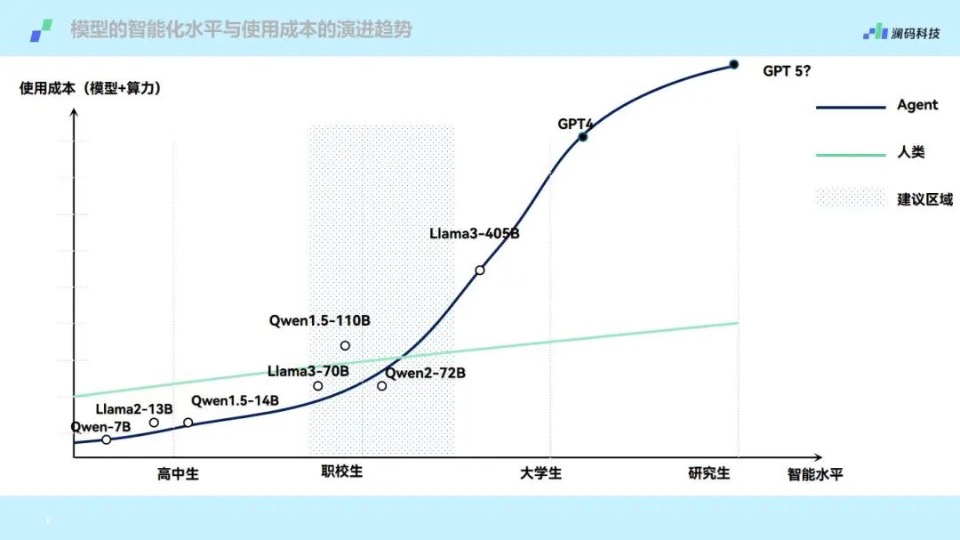

o1的发布,对国内大模型厂商而言,意味着又有”作业“可以抄了。在现在的市场上,纯文本输入输出的模型家族竞争已经十分激烈,有大量的开源/闭源、不同尺寸、不同垂直行业的文本模型。o1又会掀起新的一轮的竞争——大模型的推理能力的天花板被打开。但o1模式下,推理的算力成本又将进一步攀升,因此通过小模型、大模型协作架构来完成端到端的任务就变得更具性价比,因此,我预测,未来甚至会出现子母模型、连环模型的组合方案,目的就是将推理成本降低到同等智力的人类员工水平之下。

此外,o1的推出无疑将加速AI应用在刚需场景的落地。由于推理能力是其核心竞争力,尽管它需要分钟级别的时间来完成任务,但对于在办公室工作的人类来说,分钟级别的响应速度已经相当迅速。

在我看来,o1代表了我们可以通过投入更多的算力来生成一段逻辑一致的代码块,这种能力暗示了大量复杂业务任务自动化的潜力。例如,信贷审核、HR计算年终奖、管理会计等领域。

举一个简单的例子,许多人都有过在Excel中对任务进行建模以进行计算的经历。o1就像是未来更智能的Excel背后的“大脑”,将来只需通过对话,就能进行各种预测和分析。

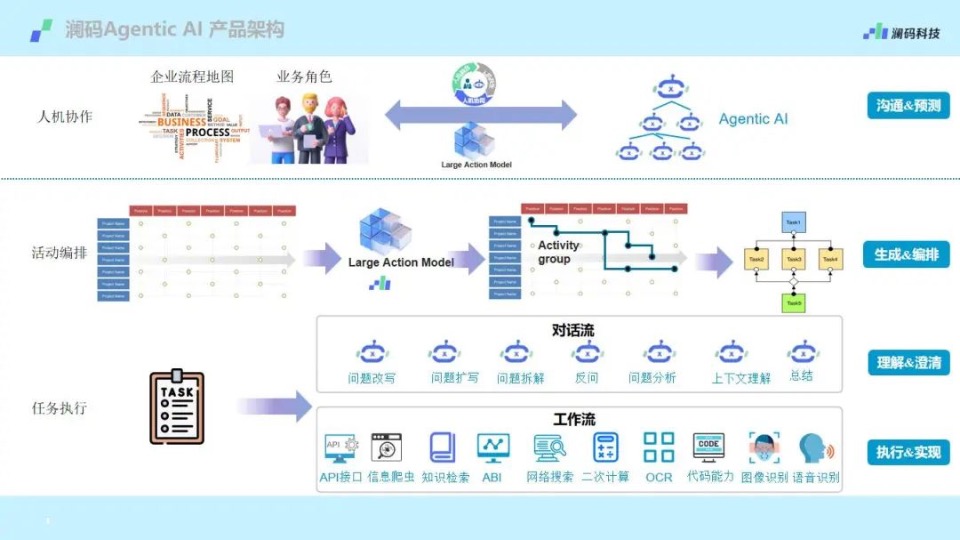

从澜码的Agentic AI产品架构上来看,o1可以作为澜码在业务活动编排中,预测下一个行动应该是什么的基座。它的推理能力能够很好的解锁更多的业务场景,也能够提高专家赋能基层业务单位的水平。

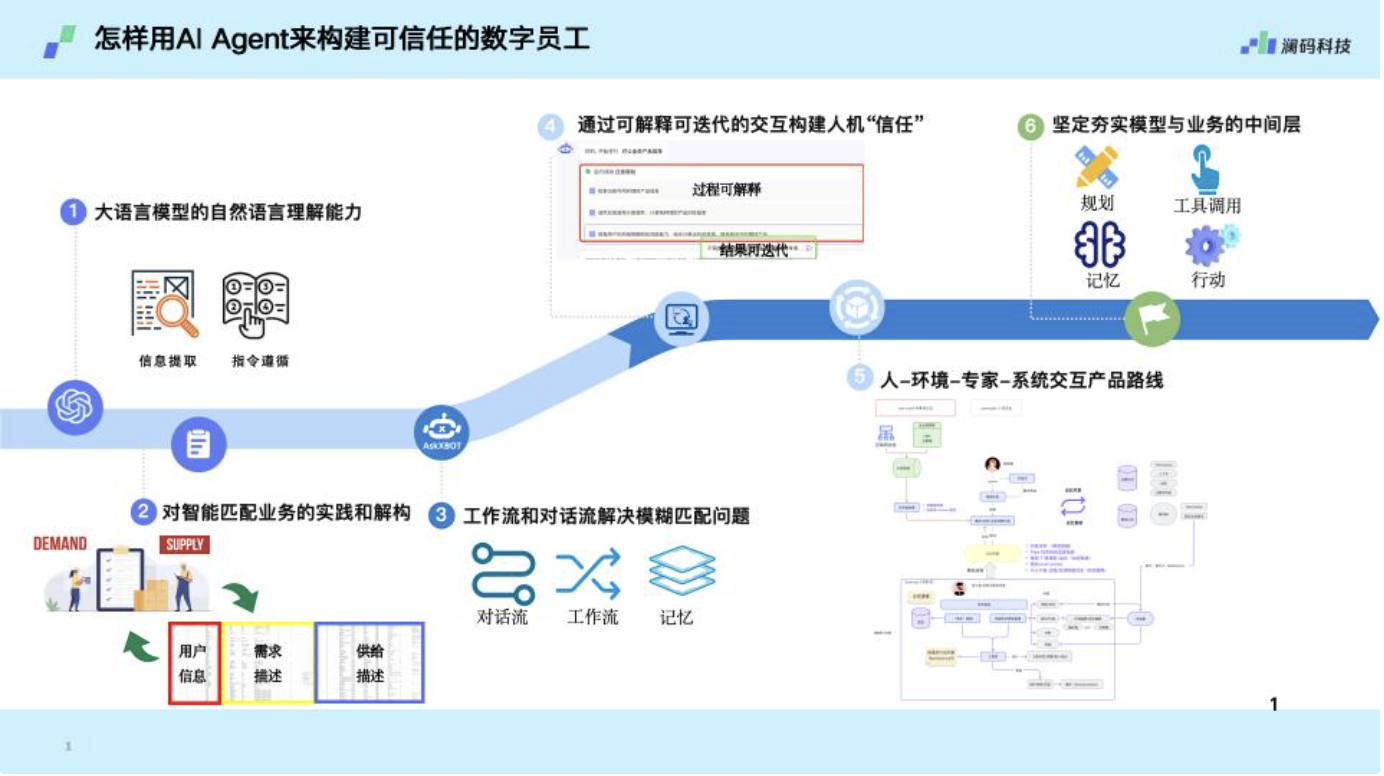

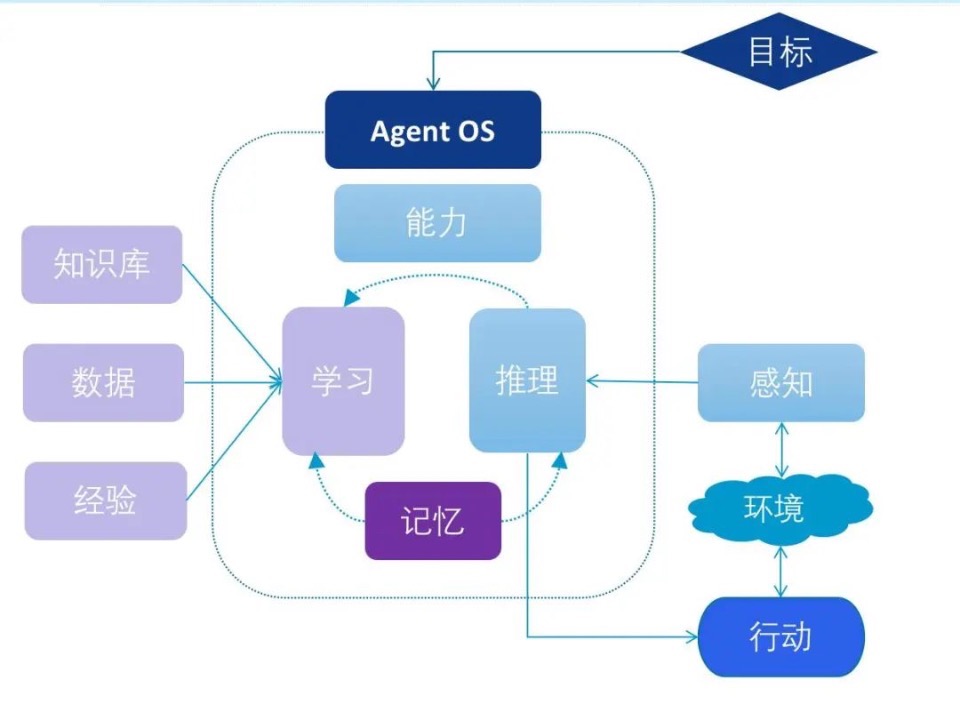

关于o1的发布,有媒体指出它已经具备了Agent的推理能力,这一点我基本上是认同的。但是,对于o1与AGI(人工通用智能)之间的关系,我仍然持有不那么乐观的态度。澜码对于Agent的概念有一个示意图,从图中可以看出,对环境的建模和对目标的理解都是实现AGI所必需的能力。然而,当前模型品类在处理真实世界中的时空关系时,仍然显得捉襟见肘。

从现有的模型架构来看,大型模型尚未具备长期记忆,因此无法回忆过去或预测未来。此外,大模型本身被限制在服务器中,缺乏对空间的感知能力。我之前提到过波普尔的“三个世界”的设想:物理世界是“世界1”,每个人脑中的主观世界是“世界2”,我们用语言符号/硅基构建出来的“世界3”。

o1目前仍然只能被困在世界3中,如果它无法主动观测世界1,或者通过世界2来理解世界1,那么它可能连基本的时空观念都无法建立,更不用说学习关于世界1的新知识了。

因此,具身智能(这不仅指物理世界中的机器人,也包括数字世界中比如澜码所设计的AI Agent)的突破至少还是一块挡在我们和AGI之间的大石头。至于搬开了这块石头后,还会不会还有下一个“坑”,就只能拭目以待了。